Como Usar o Controle de Movimento Kling 3.0: O Guia Mestre de 2026

Autor: Equipe Motion Control AI

Última atualização: 12 de maio de 2026

Categoria: Tutoriais / Geração de Vídeo por IA

Introdução

No panorama em evolução de 2026, o vídeo generativo passou da experimentação aleatória para a direção precisa. Para os criadores, o desafio já não é apenas criar um vídeo; é controlá-lo.

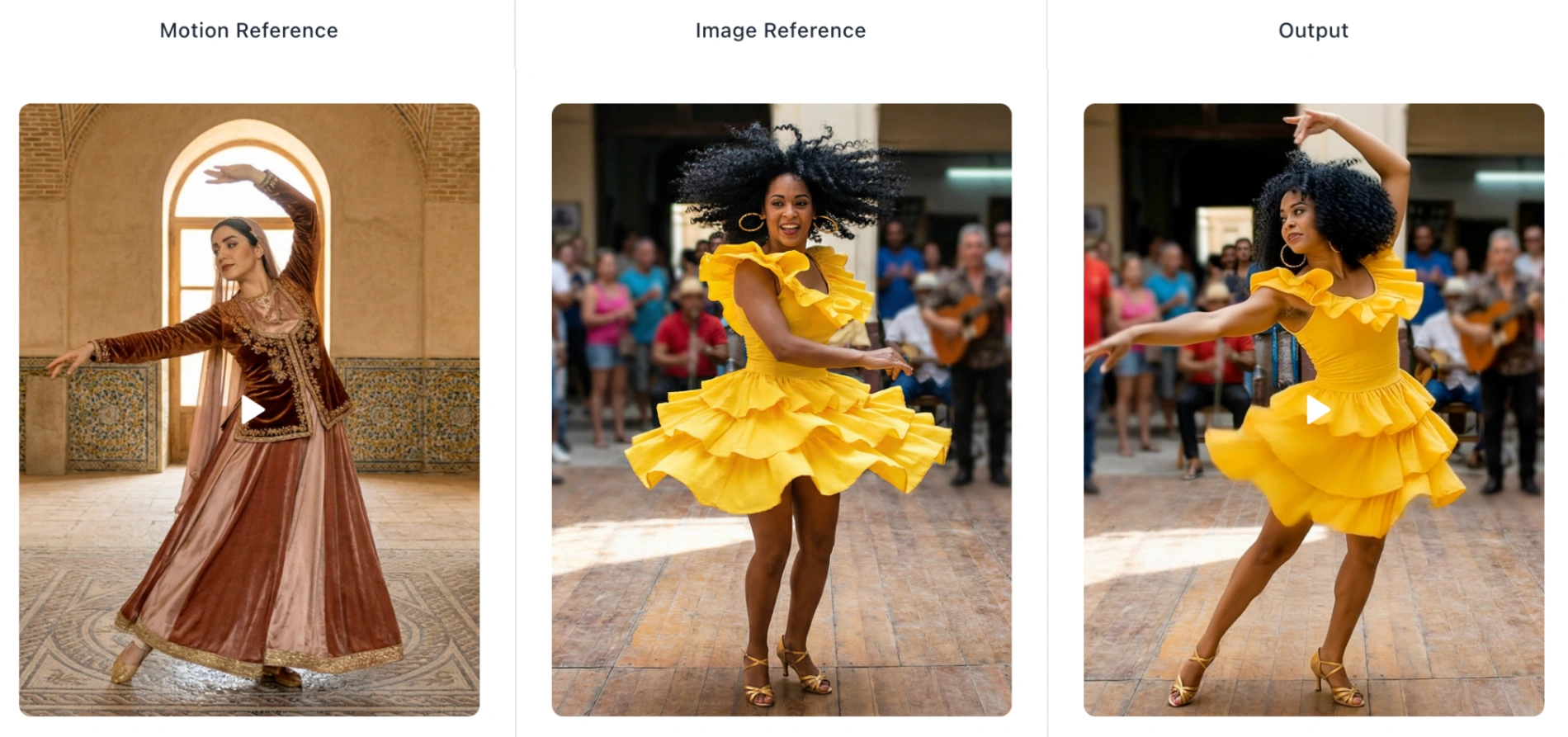

Se você já enfrentou dificuldades com personagens de IA mudando de rosto durante o movimento ou ignorando suas restrições físicas, o Controle de Movimento Kling 3.0 é a solução. Disponível diretamente em motioncontrolai.com, esta ferramenta aproveita o modelo de vídeo fotorrealista Kling 3.0 para fundir a consistência estática do personagem com performances de vídeo complexas.

Este guia explora como dominar o fluxo de trabalho "Imagem para Vídeo", garantindo que seus resultados atendam aos padrões profissionais para marketing, storytelling e redes sociais.

Por que o Controle de Movimento Kling 3.0 se Destaca em 2026

Antes de mergulharmos no "Como fazer", é crucial entender por que os profissionais estão migrando para a arquitetura de Controle de Movimento IA Kling 3.0 presente na nossa plataforma.

- Consistência Superior do Personagem: Ao contrário de modelos mais antigos que muitas vezes deformavam rostos durante o movimento, o modelo Kling 3.0 fixa a identidade do sujeito. As roupas e características do seu personagem permanecem consistentes, o que é essencial para o storytelling de marca.

- Renderização Fisicamente Precisa: O Motion Control AI não apenas anima; ele simula. Desde texturas fluidas até iluminação realista, a saída aproxima-se da fidelidade de CGI de alto nível, reduzindo significativamente o tempo de produção em comparação com a renderização tradicional.

- Trajetórias de Movimento Precisas: Você não está limitado a animações aleatórias. Você dita o caminho. Seja um movimento de dança específico ou um chute de artes marciais, o modelo segue seu vídeo de referência com alta fidelidade.

Fase 1: Preparação e Melhores Práticas (Crucial)

Com base em nossos extensos testes no Motion Control AI, a grande maioria das anomalias visuais decorre de entradas incompatíveis entre arquivos de origem. Antes de gerar, aplique estas três regras do nosso Melhor Guia:

1. A Regra do "Enquadramento Correspondente"

Consistência é fundamental. Se sua imagem de origem for um plano meio-corpo (da cintura para cima), seu vídeo de referência de movimento também deve ser um plano meio-corpo.

- Por quê? Se você usar um vídeo de caminhada de corpo inteiro com um retrato em close-up, o Kling AI tentará "comprimir" o esqueleto, levando a distorções.

2. Garanta Espaço Livre

Deixe espaço para se mover. Se sua referência de movimento envolve movimentos amplos dos braços (por exemplo, uma pose em T ou acenando), certifique-se de que sua imagem de origem tenha espaço de fundo amplo.

- Dica: Evite cortar seu personagem de origem muito apertado. O Motion Control AI precisa de "tela" para gerar os membros em movimento sem recortá-los da existência.

3. Referências de Movimento Otimizadas

Selecione vídeos de referência com movimentos claros, mas velocidade moderada. Embora o Kling AI Motion Control lide bem com ações complexas, vídeos com desfoque de movimento extremo ou tremores de câmera erráticos podem reduzir a precisão do rastreamento. Priorize vídeos onde o sujeito permanece relativamente centralizado.

Fase 2: Fluxo de Trabalho Passo a Passo

Siga este processo de 3 etapas no Motion Control AI para criar seu vídeo de Controle de Movimento Kling 3.0.

Etapa 1: Carregue seus Arquivos

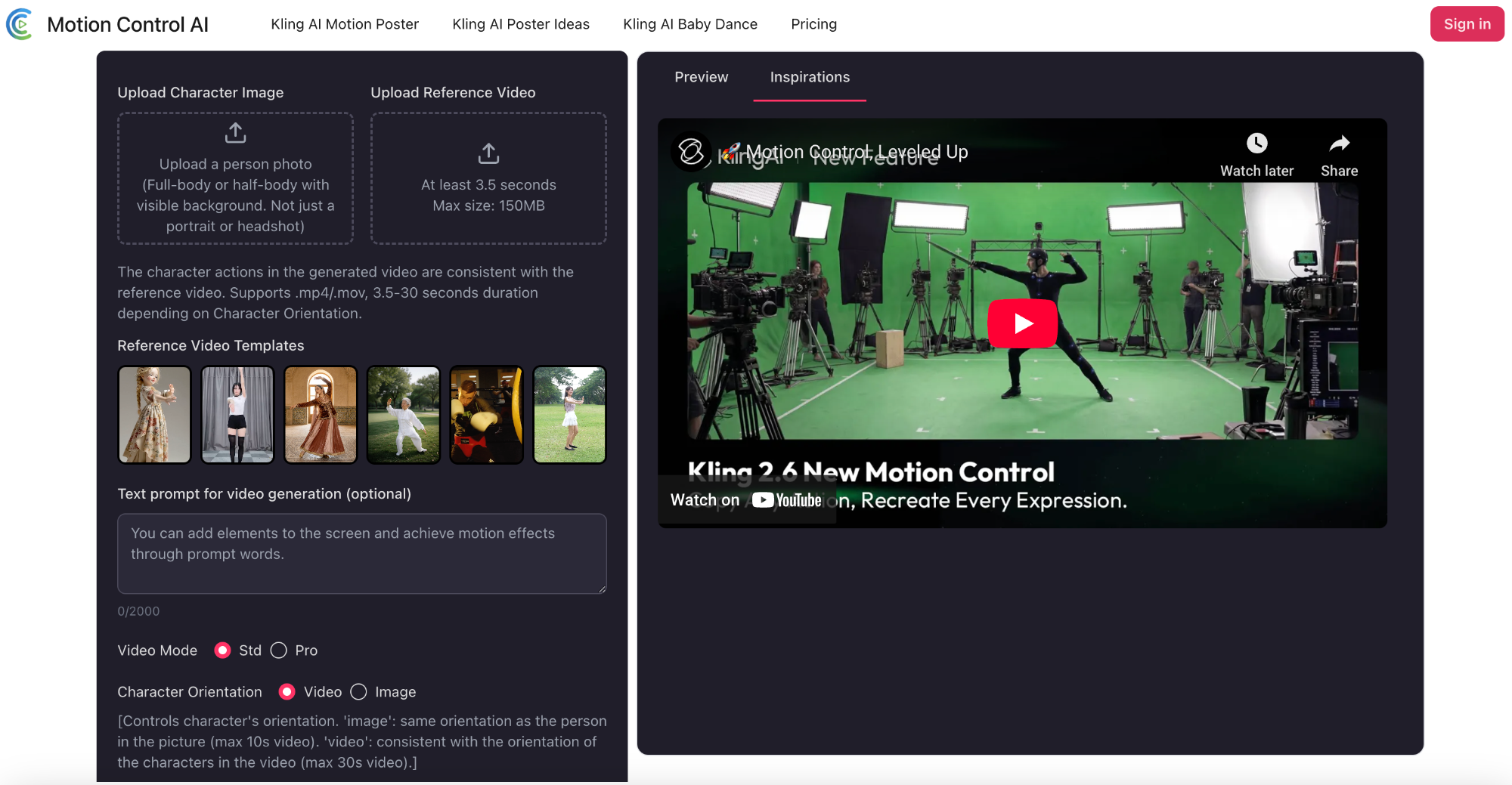

Navegue até o gerador Imagem para Vídeo: motioncontrolai.com.

- Imagem de Referência: Carregue a foto de alta resolução do seu personagem (JPG/PNG/WEBP). Corpo inteiro ou meio-corpo com fundo visível. Não apenas um retrato ou foto de rosto.

- Referência de Movimento: Carregue o clipe de vídeo que define o movimento.

As ações do personagem no vídeo gerado são consistentes com o vídeo de referência. Suporta .mp4/.mov, duração de 3,5 a 30 segundos dependendo da Orientação do Personagem.

Nota: O motor usará o esqueleto do vídeo para dirigir a imagem.

Etapa 2: Refine com Prompts de Texto

Enquanto o vídeo dita o movimento, o prompt de texto dita o contexto.

- Opcional, mas Recomendado: Use o campo Prompt de texto para definir a atmosfera ou adicionar elementos.

- Funcionalidade Avançada: Controle de Câmera

Por padrão, a IA segue a câmera do vídeo. Para adicionar seus próprios movimentos cinematográficos (como Zoom In ou Panorâmica), marque a opção "Orientação do Personagem Corresponde à Imagem". Isso permite movimento independente da câmera através de prompts de texto. - Exemplo de Prompt: "Iluminação cinematográfica, fundo de rua neon chuvosa, resolução 8k, fotorrealista."

Dica Profissional: Você pode especificar expressões faciais aqui, como "o personagem sorri", para sobrepor microexpressões ao movimento físico.

Etapa 3: Gere e Itere

Selecione Gerar.

- Gerar: Clique em 'Gerar' para ativar o motor Kling 3.0. Em instantes, visualize seu vídeo de IA dinâmico.

- Resultado: Visualize o vídeo. Se satisfeito com a trajetória e consistência, baixe o MP4 de alta resolução.

Solução Avançada de Problemas: Problemas Comuns e Correções

Mesmo em 2026, as ferramentas de IA exigem orientação. Veja como corrigir problemas comuns sobre o Controle de Movimento Kling 3.0:

- Problema: O fundo parece distorcido.

- Correção: Isso acontece quando o Kling AI 3.0 tenta mover a câmera de forma muito agressiva. Nas suas configurações ou prompt, tente estabilizar a descrição da cena (por exemplo, "fundo estático").

- Problema: As mãos parecem não naturais.

- Correção: Certifique-se de que as mãos estejam claramente visíveis tanto na imagem de origem quanto no vídeo de referência. Se o vídeo de referência esconder as mãos nos bolsos, o Motion Control AI pode ter dificuldade em renderizá-las depois.

FAQ: Entendendo o Controle de Movimento Kling 3.0

P: O vídeo gerado é adequado para uso comercial?

R: Sim. Os vídeos do Kling Motion Control gerados através dos nossos planos premium incluem direitos comerciais, tornando-os ideais para anúncios em redes sociais, vitrines de e-commerce e pré-visualização de filmes.

P: Por que este tutorial do Kling 3.0 é diferente da geração padrão de vídeo por IA?

R: Ferramentas padrão "adivinham" o movimento a partir de um prompt de texto (por exemplo, "faça ele correr"). O Controle de Movimento Kling 3.0 força a IA a seguir um esqueleto de vídeo específico, concedendo a você autoridade quadro a quadro sobre a performance.

P: Posso controlar expressões faciais específicas usando o Controle de Movimento Kling 3.0?

R: Absolutamente. Ao combinar a referência de movimento com prompts de texto específicos (por exemplo, "parecendo surpreso"), você pode animar microexpressões faciais detalhadas enquanto mantém a identidade do personagem reconhecível.

Conclusão

O Controle de Movimento Kling 3.0 representa um salto em direção à geração de vídeo controlada. Ao aderir às regras de enquadramento e utilizar o sistema de entrada dupla (Imagem + Vídeo), os criadores agora podem produzir conteúdo pronto para transmissão que não era possível antes de 2026.

Pronto para dirigir sua primeira obra-prima do Controle de Movimento Kling 3.0 IA?