Come Usare Kling 3.0 Motion Control: La Guida Definitiva 2026

Autore: Motion Control AI Team

Ultimo aggiornamento: 12 maggio 2026

Categoria: Tutorial / Generazione Video AI

Introduzione

Nel panorama in evoluzione del 2026, il video generativo è passato dalla sperimentazione casuale alla regia precisa. Per i creatori, la sfida non è più solo creare un video; è controllarlo.

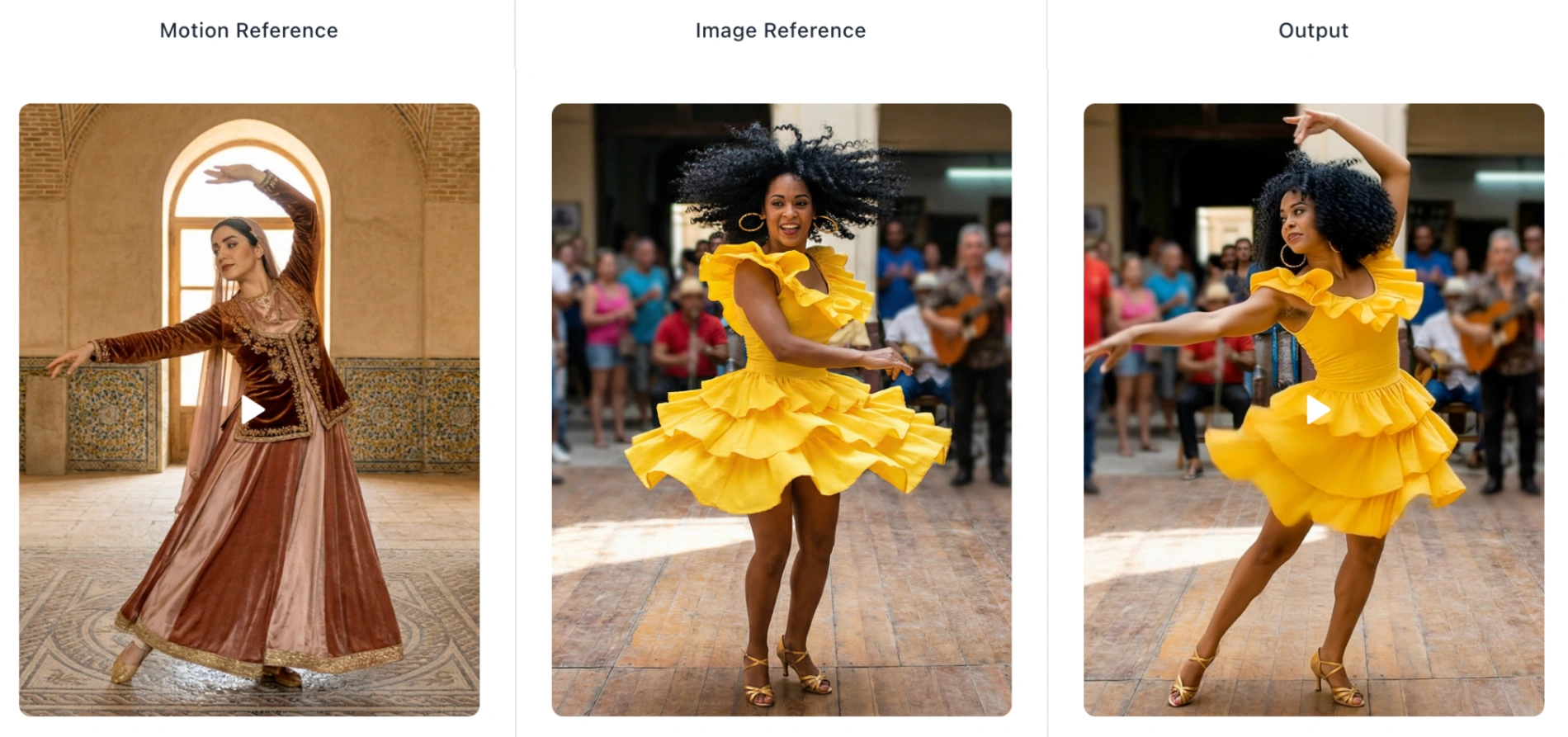

Se hai avuto difficoltà con personaggi AI che cambiano volto durante il movimento o che ignorano i tuoi vincoli fisici, Kling 3.0 Motion Control è la soluzione. Disponibile direttamente su motioncontrolai.com, questo strumento sfrutta il modello video fotorealistico Kling 3.0 per fondere la coerenza statica del personaggio con prestazioni video complesse.

Questa guida spiega come padroneggiare il flusso di lavoro "Da Immagine a Video", assicurando che i tuoi output soddisfino gli standard professionali per marketing, storytelling e social media.

Perché Kling 3.0 Motion Control si Distingue nel 2026

Prima di entrare nel "Come fare", è fondamentale capire perché i professionisti stanno passando all'architettura di Kling 3.0 AI Motion Control offerta sulla nostra piattaforma.

- Coerenza del personaggio superiore: A differenza dei modelli più vecchi che spesso deformavano i volti durante il movimento, il modello Kling 3.0 si blocca sull'identità del soggetto. L'abbigliamento e le caratteristiche del tuo personaggio rimangono coerenti, essenziali per lo storytelling del brand.

- Rendering fisicamente accurato: Motion Control AI non si limita ad animare; simula. Dalle texture fluide all'illuminazione realistica, l'output si avvicina alla fedeltà della CGI di fascia alta, riducendo significativamente i tempi di produzione rispetto al rendering tradizionale.

- Traiettorie di movimento precise: Non sei limitato ad animazioni casuali. Dettami tu il percorso. Che si tratti di un passo di danza specifico o di un calcio di arti marziali, il modello segue il tuo video di riferimento con alta fedeltà.

Fase 1: Preparazione e Best Practice (Fondamentali)

Sulla base dei nostri ampi test su Motion Control AI, la stragrande maggioranza delle anomalie visive deriva da input non corrispondenti tra i file sorgente. Prima di generare, applica queste tre regole tratte dalla nostra Guida Migliore:

1. La regola dell'"Inquadratura corrispondente"

La coerenza è fondamentale. Se la tua immagine sorgente è un'inquadratura a mezzo busto (dalla vita in su), anche il tuo video di riferimento del movimento deve essere un'inquadratura a mezzo busto.

- Perché? Se usi un video di camminata a corpo intero con un ritratto ravvicinato, Kling AI tenta di "comprimere" lo scheletro, portando a distorsioni.

2. Garantire lo spazio libero

Lascia spazio per muoverti. Se il tuo riferimento di movimento prevede ampi movimenti delle braccia (es. posa a T o agitazione), assicurati che la tua immagine sorgente abbia ampio spazio di sfondo.

- Consiglio: Evita di ritagliare il tuo personaggio sorgente troppo stretto. Motion Control AI ha bisogno di "tela" per generare gli arti in movimento senza tagliarli fuori dall'esistenza.

3. Riferimenti di movimento ottimizzati

Seleziona video di riferimento con movimenti chiari ma velocità moderata. Sebbene Kling AI Motion Control gestisca bene azioni complesse, video con motion blur estremo o tremolio irregolare della fotocamera possono ridurre la precisione del tracciamento. Dai priorità a video in cui il soggetto rimane relativamente centrato.

Fase 2: Flusso di Lavoro Passo dopo Passo

Segui questo processo in 3 passi su Motion Control AI per creare il tuo video Kling 3.0 Motion Control.

Step 1: Carica i tuoi asset

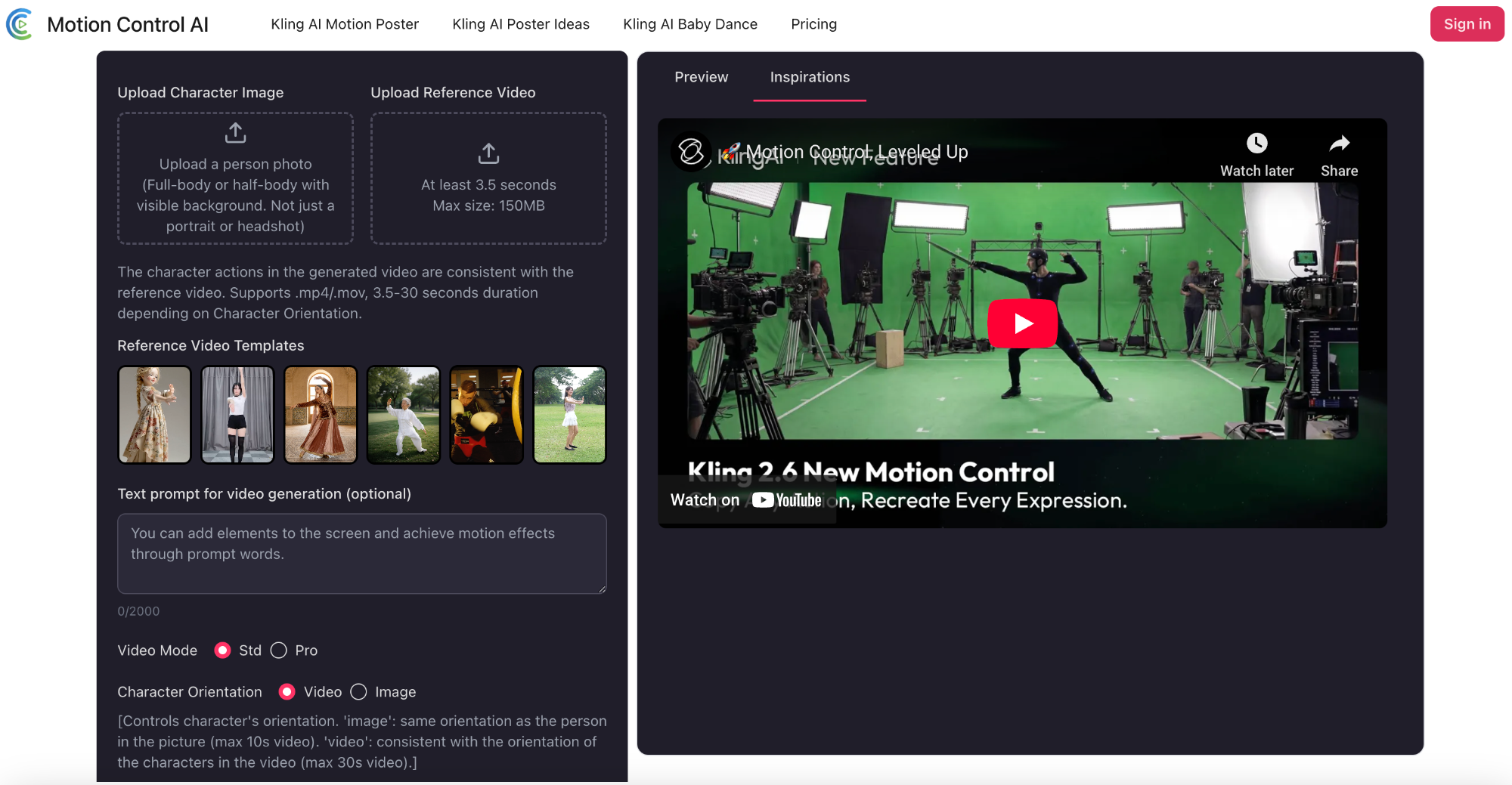

Vai al generatore Da Immagine a Video: motioncontrolai.com.

- Immagine di riferimento: Carica la foto ad alta risoluzione del tuo personaggio (JPG/PNG/WEBP). Corpo intero o mezzo busto con sfondo visibile. Non solo un ritratto o primo piano.

- Riferimento di movimento: Carica il clip video che definisce il movimento.

Le azioni del personaggio nel video generato sono coerenti con il video di riferimento. Supporta .mp4/.mov, durata 3,5–30 secondi a seconda dell'orientamento del personaggio.

Nota: Il motore utilizzerà lo scheletro del video per guidare l'immagine.

Step 2: Perfeziona con prompt di testo

Mentre il video detta il movimento, il prompt di testo detta il contesto.

- Opzionale ma consigliato: Usa il campo Prompt di testo per definire l'atmosfera o aggiungere elementi.

- Funzionalità avanzata: Controllo della fotocamera

Per impostazione predefinita, l'AI segue la fotocamera del video. Per aggiungere movimenti cinematografici personalizzati (come Zoom In o Pan), attiva l'impostazione "L'orientamento del personaggio corrisponde all'immagine". Questo permette movimenti di fotocamera indipendenti tramite prompt di testo. - Esempio di prompt: "Illuminazione cinematografica, sfondo stradale con pioggia al neon, risoluzione 8k, fotorealistico."

Consiglio da professionista: Puoi specificare qui le espressioni facciali, come "il personaggio sorride", per sovrapporre micro-espressioni al movimento fisico.

Step 3: Genera e itera

Seleziona Genera.

- Genera: Clicca 'Genera' per attivare il motore Kling 3.0. In pochi istanti, visualizza l'anteprima del tuo video AI dinamico.

- Risultato: Anteprima del video. Se soddisfatto della traiettoria e della coerenza, scarica il video MP4 ad alta risoluzione.

Risoluzione Avanzata dei Problemi: Problemi Comuni e Soluzioni

Anche nel 2026, gli strumenti AI richiedono guida. Ecco come risolvere i problemi comuni con Kling 3.0 Motion Control:

- Problema: Lo sfondo appare distorto.

- Soluzione: Succede quando Kling AI 3.0 cerca di muovere la fotocamera troppo aggressivamente. Nelle impostazioni o nel prompt, prova a stabilizzare la descrizione della scena (es. "sfondo statico").

- Problema: Le mani sembrano innaturali.

- Soluzione: Assicurati che le mani siano chiaramente visibili sia nell'immagine sorgente che nel video di riferimento. Se il video di riferimento nasconde le mani in tasca, Motion Control AI potrebbe avere difficoltà a renderizzarle in seguito.

FAQ: Comprendere Kling 3.0 Motion Control

D: Il video generato è adatto per uso commerciale?

R: Sì. I video Kling Motion Control generati tramite i nostri piani premium includono diritti commerciali, rendendoli ideali per annunci sui social media, showcase e-commerce e pre-visualizzazione di film.

D: Perché questo tutorial su Kling 3.0 è diverso dalla generazione video AI standard?

R: Gli strumenti standard "indovinano" il movimento da un prompt di testo (es. "fallo correre"). Kling 3.0 Motion Control costringe l'AI a seguire uno scheletro video specifico, dandoti autorità fotogramma per fotogramma sulla prestazione.

D: Posso controllare espressioni facciali specifiche con Kling 3.0 Motion Control?

R: Assolutamente. Combinando il riferimento di movimento con prompt di testo specifici (es. "apparire sorpreso"), puoi animare dettagliate micro-espressioni facciali mantenendo l'identità riconoscibile del personaggio.

Conclusione

Kling 3.0 Motion Control rappresenta un balzo in avanti nella generazione video controllata. Rispettando le regole di inquadratura e utilizzando il sistema a doppio input (Immagine + Video), i creatori possono ora produrre contenuti pronti per la trasmissione che non erano possibili prima del 2026.

Pronto a dirigere il tuo primo capolavoro con Kling 3.0 Motion Control AI?