Comment utiliser Kling 3.0 Motion Control : le guide de référence 2026

Auteur : Motion Control AI Team

Dernière mise à jour : 12 mai 2026

Catégorie : Tutoriels / Génération vidéo IA

Introduction

Dans le paysage en constante évolution de 2026, la vidéo générative est passée de l'expérimentation aléatoire à la direction précise. Pour les créateurs, le défi n'est plus seulement de créer une vidéo, mais de la contrôler.

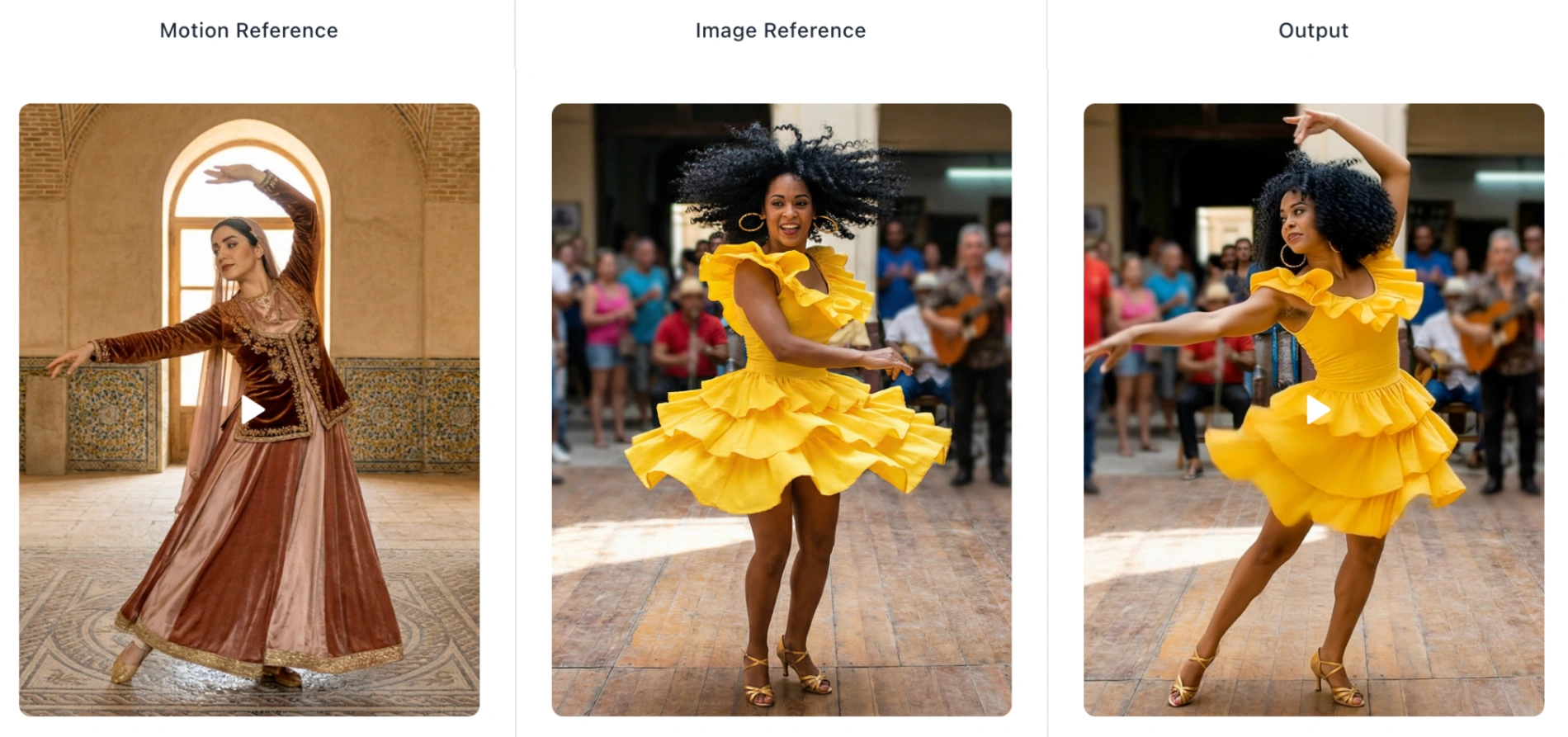

Si vous avez déjà été confronté à des personnages IA qui changent de visage en cours de mouvement ou qui ignorent vos contraintes physiques, Kling 3.0 Motion Control est la solution. Disponible directement sur motioncontrolai.com, cet outil exploite le modèle vidéo photoréaliste Kling 3.0 pour fusionner la cohérence statique des personnages avec une performance vidéo complexe.

Ce guide explore comment maîtriser le flux de travail « Image vers vidéo », afin que vos productions répondent aux normes professionnelles du marketing, du storytelling et des réseaux sociaux.

Pourquoi Kling 3.0 Motion Control se démarque en 2026

Avant de plonger dans le « Comment faire », il est essentiel de comprendre pourquoi les professionnels adoptent l'architecture Kling 3.0 AI Motion Control présente sur notre plateforme.

- Cohérence supérieure du personnage : Contrairement aux modèles plus anciens qui déformaient souvent les visages en mouvement, le modèle Kling 3.0 verrouille l'identité du sujet. Les vêtements et les traits de votre personnage restent cohérents, ce qui est essentiel pour le storytelling de marque.

- Rendu physiquement exact : Motion Control AI ne se contente pas d'animer, il simule. Des textures fluides à l'éclairage réaliste, la sortie s'approche de la fidélité des images de synthèse haut de gamme, réduisant considérablement le temps de production par rapport au rendu traditionnel.

- Trajectoires de mouvement précises : Vous n'êtes pas limité à des animations aléatoires. Vous dictez le chemin. Que ce soit un mouvement de danse spécifique ou un coup de pied martial, le modèle suit votre vidéo de référence avec une haute fidélité.

Phase 1 : Préparation et bonnes pratiques (essentielles)

Sur la base de nos nombreux tests chez Motion Control AI, la grande majorité des anomalies visuelles proviennent d'entrées mal adaptées entre les fichiers sources. Avant de générer, appliquez ces trois règles issues de notre Meilleur guide :

1. La règle du « Cadre correspondant »

La cohérence est la clé. Si votre image source est un plan en demi-corps (taille et au-dessus), votre vidéo de mouvement de référence doit également être un plan en demi-corps.

- Pourquoi ? Si vous utilisez une vidéo de marche en pied avec un portrait en gros plan, l'IA Kling tente de « compresser » le squelette, ce qui entraîne des distorsions.

2. Assurer un espace libre suffisant

Laissez de la place pour bouger. Si votre référence de mouvement implique de grands mouvements des bras (par exemple, une pose en T ou un geste de la main), assurez-vous que votre image source dispose d'un espace d'arrière-plan suffisant.

- Astuce : Évitez de recadrer votre personnage source trop serré. L'IA Motion Control a besoin de « toile » pour générer les membres en mouvement sans les tronquer.

3. Références de mouvement optimisées

Sélectionnez des vidéos de référence avec des mouvements clairs mais une vitesse modérée. Bien que Kling AI Motion Control gère bien les actions complexes, les vidéos avec un flou de mouvement extrême ou des secousses de caméra irrégulières peuvent réduire la précision du suivi. Privilégiez les vidéos où le sujet reste relativement centré.

Phase 2 : Flux de travail étape par étape

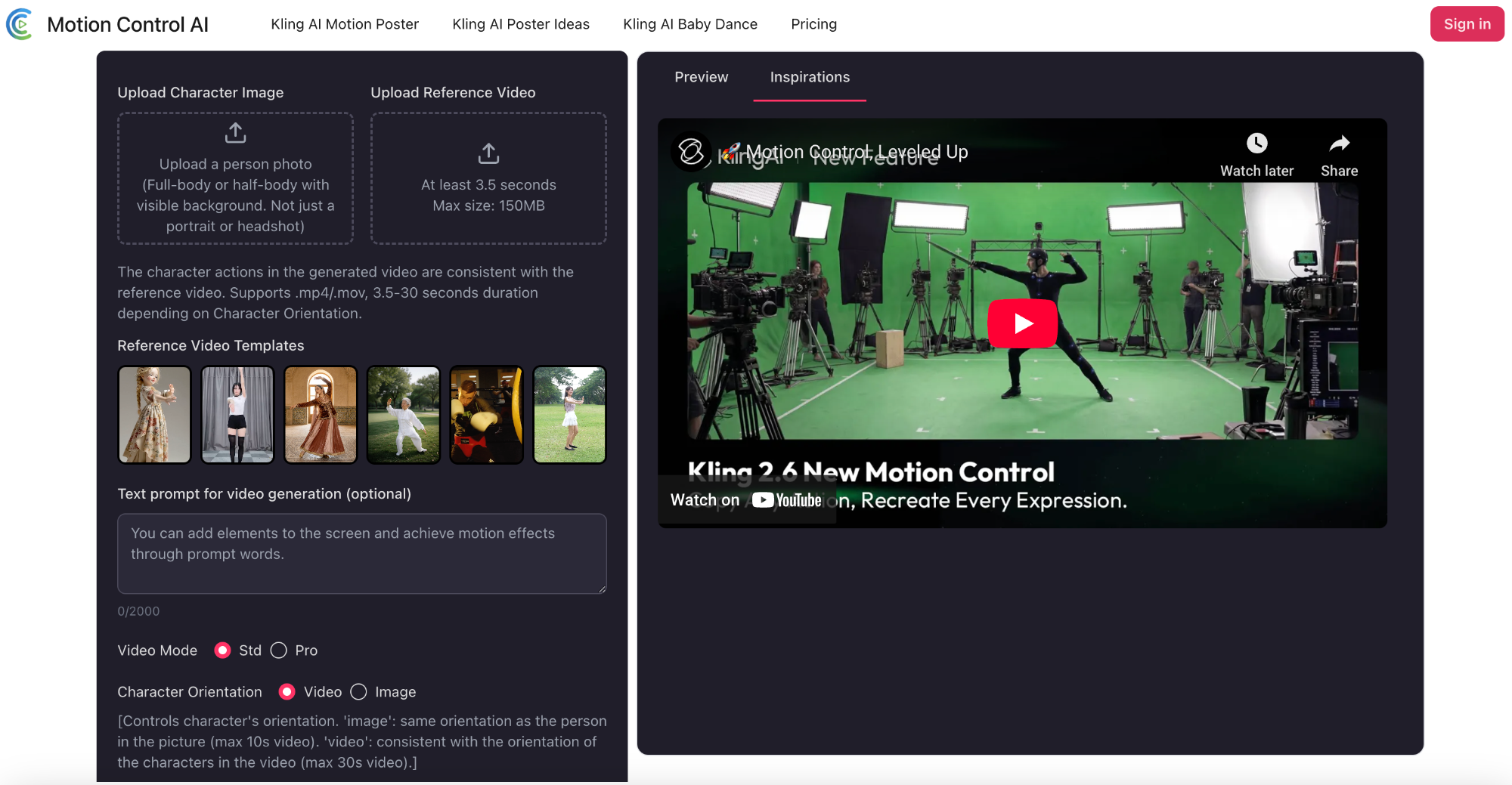

Suivez ce processus en 3 étapes sur Motion Control AI pour créer votre vidéo Kling 3.0 Motion Control.

Étape 1 : Téléchargez vos fichiers

Accédez au générateur Image vers vidéo : motioncontrolai.com.

- Image de référence : Téléchargez la photo haute résolution de votre personnage (JPG/PNG/WEBP). Plan plein corps ou demi-corps avec arrière-plan visible. Pas seulement un portrait ou un gros plan.

- Référence de mouvement : Téléchargez le clip vidéo qui définit le mouvement.

Les actions du personnage dans la vidéo générée sont cohérentes avec la vidéo de référence. Prend en charge .mp4/.mov, durée de 3,5 à 30 secondes selon l'orientation du personnage.

Remarque : Le moteur utilisera le squelette de la vidéo pour animer l'image.

Étape 2 : Affinez avec des instructions textuelles

Alors que la vidéo dicte le mouvement, l'instruction textuelle dicte le contexte.

- Optionnel mais recommandé : Utilisez le champ Instruction textuelle pour définir l'atmosphère ou ajouter des éléments.

- Fonctionnalité avancée : Contrôle de la caméra

Par défaut, l'IA suit la caméra de la vidéo. Pour ajouter vos propres mouvements cinématographiques (comme un zoom avant ou un panoramique), cochez le paramètre « L'orientation du personnage correspond à l'image ». Cela permet un mouvement de caméra indépendant via les instructions textuelles. - Exemple d'instruction : « Éclairage cinématographique, rue pluvieuse néon en arrière-plan, résolution 8k, photoréaliste. »

Astuce : Vous pouvez spécifier ici des expressions faciales, comme « le personnage sourit », pour superposer des micro-expressions sur le mouvement physique.

Étape 3 : Générer et itérer

Sélectionnez Générer.

- Générer : Cliquez sur « Générer » pour lancer le moteur Kling 3.0. En quelques instants, prévisualisez votre vidéo IA dynamique.

- Résultat : Prévisualisez la vidéo. Si la trajectoire et la cohérence vous satisfont, téléchargez le MP4 haute résolution.

Dépannage avancé : Problèmes courants et correctifs

Même en 2026, les outils IA nécessitent des ajustements. Voici comment résoudre les problèmes courants liés à Kling 3.0 Motion Control :

- Problème : L'arrière-plan semble déformé.

- Correctif : Cela se produit lorsque Kling AI 3.0 tente de déplacer la caméra trop agressivement. Dans vos paramètres ou votre instruction, essayez de stabiliser la description de la scène (par exemple, « arrière-plan statique »).

- Problème : Les mains semblent peu naturelles.

- Correctif : Assurez-vous que les mains sont clairement visibles à la fois dans l'image source et la vidéo de référence. Si la vidéo de référence cache les mains dans les poches, l'IA Motion Control peut avoir du mal à les rendre correctement.

FAQ : Comprendre Kling 3.0 Motion Control

Q : La vidéo générée est-elle adaptée à un usage commercial ?

R : Oui. Les vidéos Kling Motion Control générées via nos formules premium incluent les droits commerciaux, ce qui les rend idéales pour les publicités sur les réseaux sociaux, les vitrines e-commerce et la prévisualisation de films.

Q : Pourquoi ce tutoriel Kling 3.0 est-il différent de la génération vidéo IA standard ?

R : Les outils standard « devinent » le mouvement à partir d'une instruction textuelle (ex : « fais-le courir »). Kling 3.0 Motion Control oblige l'IA à suivre un squelette vidéo spécifique, vous donnant une autorité image par image sur la performance.

Q : Puis-je contrôler des expressions faciales spécifiques avec Kling 3.0 Motion Control ?

R : Absolument. En combinant la référence de mouvement avec des instructions textuelles précises (ex : « regard surpris »), vous pouvez animer des micro-expressions faciales détaillées tout en gardant l'identité du personnage reconnaissable.

Conclusion

Kling 3.0 Motion Control représente un bond en avant dans la génération vidéo contrôlée. En respectant les règles de cadrage et en utilisant le système à double entrée (Image + Vidéo), les créateurs peuvent désormais produire un contenu prêt à diffuser qui était impossible avant 2026.

Prêt à diriger votre premier chef-d'œuvre Kling 3.0 Motion Control AI ?