Cómo Usar el Control de Movimiento de Kling 3.0: La Guía Maestra 2026

Autor: Equipo de Control de Movimiento AI

Última actualización: 12 de mayo de 2026

Categoría: Tutoriales / Generación de Video con IA

Introducción

En el cambiante panorama de 2026, el video generativo ha pasado de la experimentación aleatoria a la dirección precisa. Para los creadores, el desafío ya no es solo crear un video; es controlarlo.

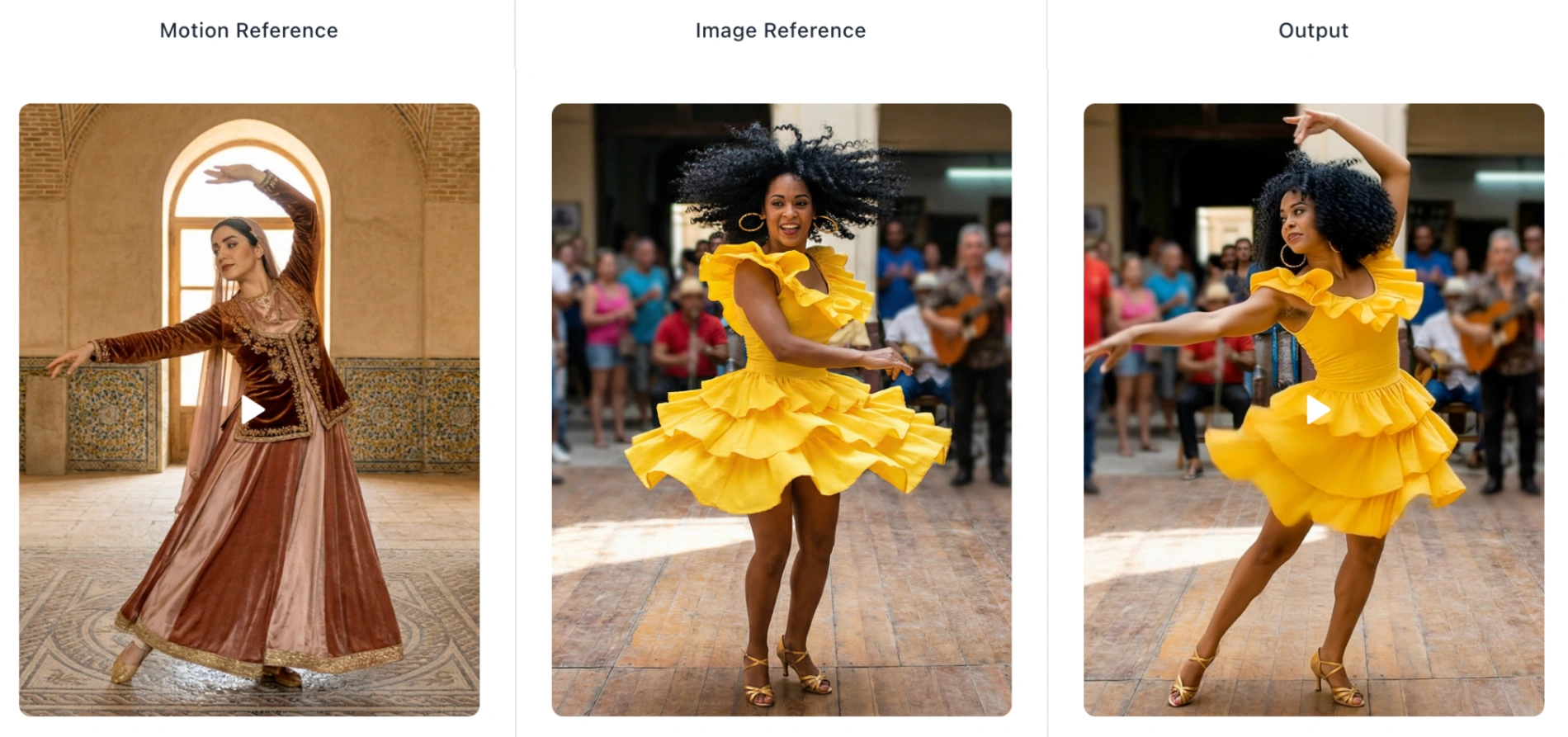

Si has luchado con personajes de IA que cambian de rostro en medio del movimiento o ignoran tus restricciones físicas, Kling 3.0 Motion Control es la solución. Disponible directamente en motioncontrolai.com, esta herramienta aprovecha el modelo de video fotorrealista Kling 3.0 para fusionar la consistencia estática del personaje con un rendimiento de video complejo.

Esta guía explora cómo dominar el flujo de trabajo "De imagen a video", asegurando que tus resultados cumplan con los estándares profesionales para marketing, narración de historias y redes sociales.

Por qué Kling 3.0 Motion Control se destaca en 2026

Antes de sumergirnos en el "Cómo hacerlo", es crucial entender por qué los profesionales están migrando a la arquitectura de Control de Movimiento AI Kling 3.0 presentada en nuestra plataforma.

- Consistencia superior del personaje: A diferencia de modelos antiguos que a menudo deformaban los rostros durante el movimiento, el modelo Kling 3.0 se fija en la identidad del sujeto. La vestimenta y las características de tu personaje se mantienen consistentes, algo esencial para la narrativa de marca.

- Renderizado físicamente preciso: Motion Control AI no solo anima; simula. Desde texturas fluidas hasta iluminación realista, el resultado se acerca a la fidelidad del CGI de alta gama, reduciendo significativamente el tiempo de producción en comparación con el renderizado tradicional.

- Trayectorias de movimiento precisas: No estás limitado a animaciones aleatorias. Tú dictas el camino. Ya sea un movimiento de baile específico o una patada de artes marciales, el modelo sigue tu video de referencia con alta fidelidad.

Fase 1: Preparación y mejores prácticas (Crucial)

Basado en nuestras pruebas exhaustivas en Motion Control AI, la gran mayoría de las anomalías visuales provienen de entradas incompatibles entre los archivos fuente. Antes de generar, aplica estas tres reglas de nuestra Mejor Guía:

1. La regla de "Emparejamiento de encuadre"

La consistencia es clave. Si tu imagen fuente es un plano de medio cuerpo (de la cintura para arriba), tu video de referencia de movimiento también debe ser un plano de medio cuerpo.

- ¿Por qué? Si usas un video de caminata de cuerpo completo con un retrato en primer plano, Kling AI intentará "comprimir" el esqueleto, lo que lleva a distorsiones.

2. Asegurar espacio libre

Deja espacio para moverse. Si tu referencia de movimiento implica movimientos amplios de brazos (por ejemplo, una pose en T o saludar), asegúrate de que tu imagen fuente tenga suficiente espacio de fondo.

- Consejo: Evita recortar demasiado a tu personaje fuente. Motion Control AI necesita "lienzo" para generar las extremidades en movimiento sin recortarlas.

3. Referencias de movimiento optimizadas

Selecciona videos de referencia con movimientos claros pero velocidad moderada. Aunque Kling AI Motion Control maneja bien las acciones complejas, los videos con desenfoque de movimiento extremo o movimientos erráticos de cámara pueden reducir la precisión del seguimiento. Prioriza videos donde el sujeto permanezca relativamente centrado.

Fase 2: Flujo de trabajo paso a paso

Sigue este proceso de 3 pasos en Motion Control AI para crear tu video de Control de Movimiento Kling 3.0.

Paso 1: Sube tus archivos

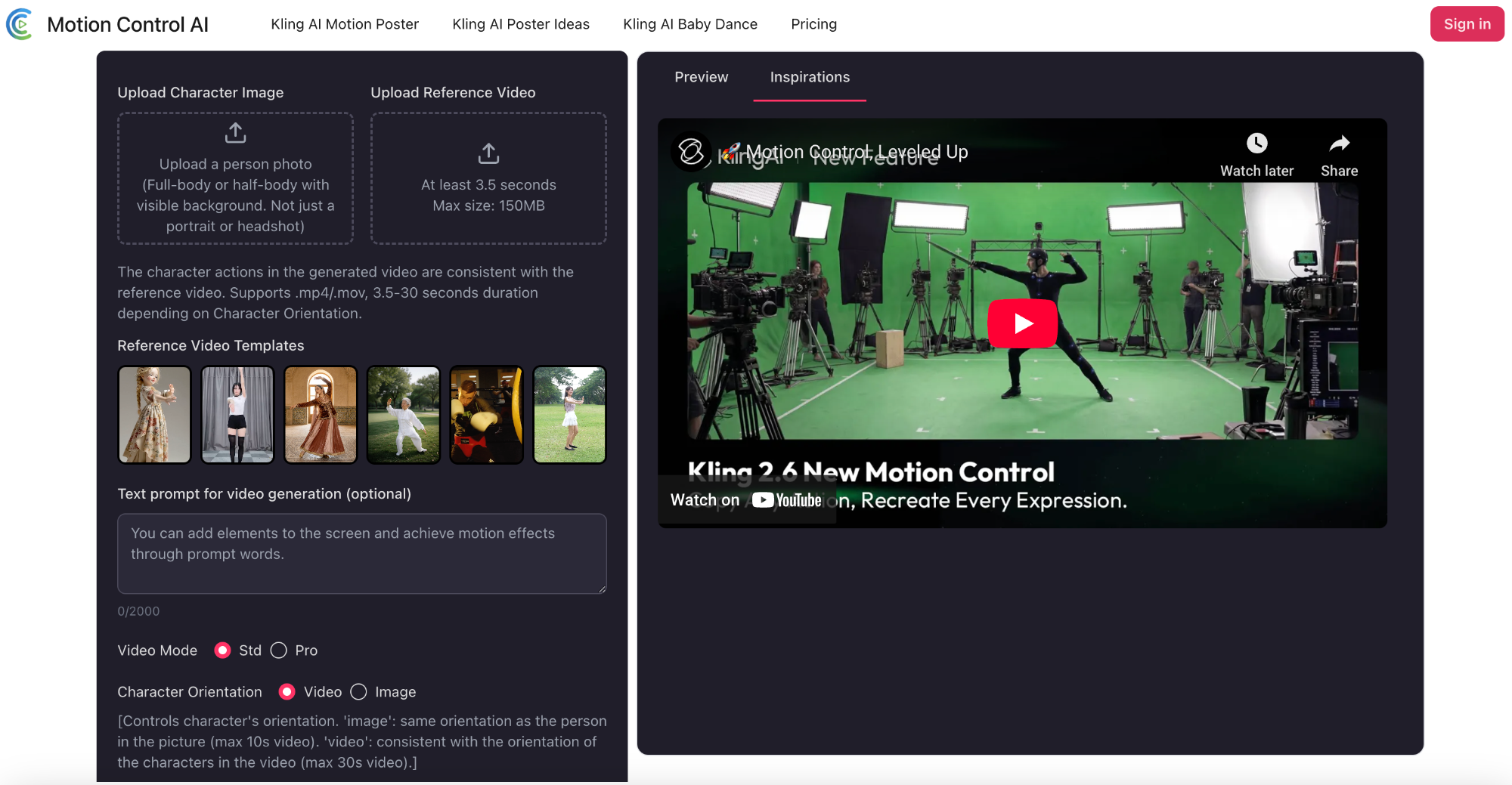

Navega al generador De imagen a video: motioncontrolai.com.

- Imagen de referencia: Sube la foto de alta resolución de tu personaje (JPG/PNG/WEBP). De cuerpo completo o medio cuerpo con fondo visible. No solo un retrato o primer plano.

- Referencia de movimiento: Sube el clip de video que define el movimiento.

Las acciones del personaje en el video generado son consistentes con el video de referencia. Admite .mp4/.mov, duración de 3.5 a 30 segundos dependiendo de la orientación del personaje.

Nota: El motor usará el esqueleto del video para impulsar la imagen.

Paso 2: Refina con indicaciones de texto

Mientras que el video dicta el movimiento, la indicación de texto dicta el contexto.

- Opcional pero recomendado: Usa el campo Indicación de texto para definir la atmósfera o añadir elementos.

- Función avanzada: Control de cámara

Por defecto, la IA sigue la cámara del video. Para añadir tus propios movimientos cinematográficos (como Zoom In o Panorámica), marca la opción "La orientación del personaje coincide con la imagen". Esto permite movimiento de cámara independiente a través de indicaciones de texto. - Ejemplo de indicación: "Iluminación cinematográfica, fondo de calle lluviosa de neón, resolución 8k, fotorrealista."

Consejo profesional: Puedes especificar expresiones faciales aquí, como "el personaje sonríe", para superponer microexpresiones sobre el movimiento físico.

Paso 3: Genera e itera

Selecciona Generar.

- Generar: Haz clic en 'Generar' para activar el motor Kling 3.0. En cuestión de momentos, previsualiza tu video dinámico con IA.

- Resultado: Previsualiza el video. Si estás satisfecho con la trayectoria y la consistencia, descarga el MP4 de alta resolución.

Solución avanzada de problemas: Problemas comunes y soluciones

Incluso en 2026, las herramientas de IA requieren orientación. Aquí te mostramos cómo solucionar problemas comunes con Kling 3.0 Motion Control:

- Problema: El fondo se ve distorsionado.

- Solución: Esto ocurre cuando Kling AI 3.0 intenta mover la cámara de manera demasiado agresiva. En tu configuración o indicación, intenta estabilizar la descripción de la escena (por ejemplo, "fondo estático").

- Problema: Las manos se ven antinaturales.

- Solución: Asegúrate de que las manos sean claramente visibles tanto en la imagen fuente como en el video de referencia. Si el video de referencia esconde las manos en los bolsillos, Motion Control AI podría tener dificultades para renderizarlas después.

Preguntas Frecuentes: Entendiendo Kling 3.0 Motion Control

P: ¿El video generado es adecuado para uso comercial?

R: Sí. Los videos de Kling Motion Control generados a través de nuestros planes premium incluyen derechos comerciales, lo que los hace ideales para anuncios en redes sociales, exhibiciones de comercio electrónico y previsualización de películas.

P: ¿Por qué este tutorial de Kling 3.0 es diferente de la generación estándar de video con IA?

R: Las herramientas estándar "adivinan" el movimiento a partir de una indicación de texto (por ejemplo, "haz que corra"). Kling 3.0 Motion Control obliga a la IA a seguir un esqueleto de video específico, otorgándote autoridad cuadro por cuadro sobre el rendimiento.

P: ¿Puedo controlar expresiones faciales específicas usando Kling 3.0 Motion Control?

R: Absolutamente. Combinando la referencia de movimiento con indicaciones de texto específicas (por ejemplo, "parece sorprendido"), puedes animar microexpresiones faciales detalladas mientras mantienes reconocible la identidad del personaje.

Conclusión

Kling 3.0 Motion Control representa un salto adelante en la generación de video controlada. Al adherirse a las reglas de encuadre y utilizar el sistema de doble entrada (Imagen + Video), los creadores ahora pueden producir contenido listo para transmisión que no era posible antes de 2026.

¿Listo para dirigir tu primera obra maestra con Kling 3.0 Motion Control AI?