So nutzen Sie Kling 3.0 Motion Control: Der umfassende Leitfaden 2026

Autor: Motion Control AI Team

Letzte Aktualisierung: 12. Mai 2026

Kategorie: Tutorials / KI-Videogenerierung

Einleitung

In der sich ständig weiterentwickelnden Landschaft des Jahres 2026 hat sich generative Videoerstellung von zufälligen Experimenten hin zu präziser Steuerung entwickelt. Für Kreative liegt die Herausforderung nicht mehr nur darin, ein Video zu erstellen, sondern es zu kontrollieren.

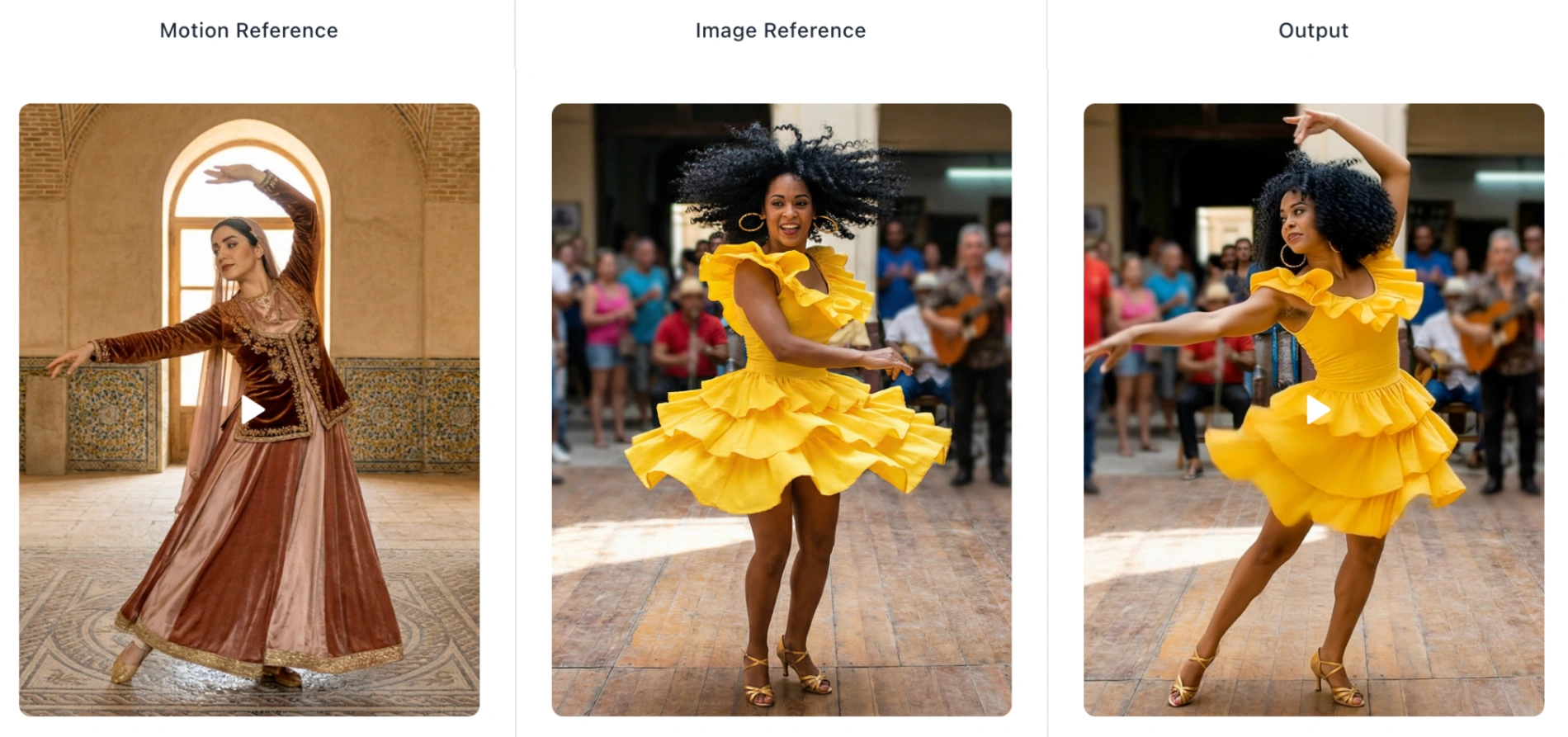

Wenn Sie schon einmal erlebt haben, dass KI-Charaktere während einer Bewegung das Gesicht verändern oder Ihre physikalischen Vorgaben ignorieren, dann ist Kling 3.0 Motion Control die Lösung. Verfügbar direkt auf motioncontrolai.com, nutzt dieses Tool das fotorealistische Kling 3.0 Videomodell, um statische Charakterkonsistenz mit komplexen Videobewegungen zu vereinen.

Dieser Leitfaden zeigt, wie Sie den „Bild-zu-Video“-Workflow meistern, sodass Ihre Ergebnisse professionellen Standards für Marketing, Storytelling und soziale Medien entsprechen.

Warum Kling 3.0 Motion Control im Jahr 2026 heraussticht

Bevor wir ins Detail gehen, ist es wichtig zu verstehen, warum Profis auf die auf unserer Plattform verfügbare Kling 3.0 KI Motion Control Architektur umsteigen.

- Überlegene Charakterkonsistenz: Im Gegensatz zu älteren Modellen, die bei Bewegungen oft Gesichter verzerrten, fixiert sich das Kling 3.0 Modell auf die Identität des Subjekts. Kleidung und Merkmale Ihres Charakters bleiben konsistent – entscheidend für Marken-Storytelling.

- Physikalisch genaues Rendering: Motion Control AI animiert nicht nur, sondern simuliert. Von fließenden Texturen bis zu realistischer Beleuchtung erreicht die Ausgabe die Qualität von High-End-CGI und reduziert die Produktionszeit im Vergleich zu traditionellem Rendering erheblich.

- Präzise Bewegungspfade: Sie sind nicht auf zufällige Animationen beschränkt. Sie geben den Weg vor. Ob es sich um eine bestimmte Tanzbewegung oder einen Kampfsporttritt handelt – das Modell folgt Ihrem Referenzvideo mit hoher Genauigkeit.

Phase 1: Vorbereitung & Best Practices (entscheidend)

Basierend auf unseren umfangreichen Tests bei Motion Control AI entstehen die meisten visuellen Anomalien durch nicht aufeinander abgestimmte Eingaben zwischen den Quelldateien. Beachten Sie vor der Generierung diese drei Regeln aus unserem Best Guide:

1. Die „Bildausschnitt-Passung“-Regel

Konsistenz ist der Schlüssel. Wenn Ihr Quellbild ein Halbkörper-Shot ist (ab der Taille aufwärts), muss Ihr Bewegungsreferenzvideo ebenfalls ein Halbkörper-Shot sein.

- Warum? Wenn Sie ein Ganzkörper-Gehen-Video mit einer Nahaufnahme des Porträts verwenden, versucht die Kling KI, das Skelett zu „komprimieren“, was zu Verzerrungen führt.

2. Ausreichend Bewegungsfreiraum schaffen

Lassen Sie Platz für Bewegung. Wenn Ihre Bewegungsreferenz weite Armbewegungen beinhaltet (z. B. eine T-Pose oder Winken), stellen Sie sicher, dass Ihr Quellbild genügend Hintergrundfläche hat.

- Tipp: Vermeiden Sie es, den Quellcharakter zu eng zuzuschneiden. Die Motion Control AI benötigt eine „Leinwand“, um die bewegten Gliedmaßen zu generieren, ohne sie abzuschneiden.

3. Optimierte Bewegungsreferenzen

Wählen Sie Referenzvideos mit klaren Bewegungen, aber moderater Geschwindigkeit. Obwohl die Kling AI Motion Control komplexe Aktionen gut verarbeitet, können Videos mit starkem Bewegungsunschärfe oder ruckeligen Kamerabewegungen die Tracking-Genauigkeit verringern. Bevorzugen Sie Videos, bei denen das Subjekt relativ mittig bleibt.

Phase 2: Schritt-für-Schritt-Workflow

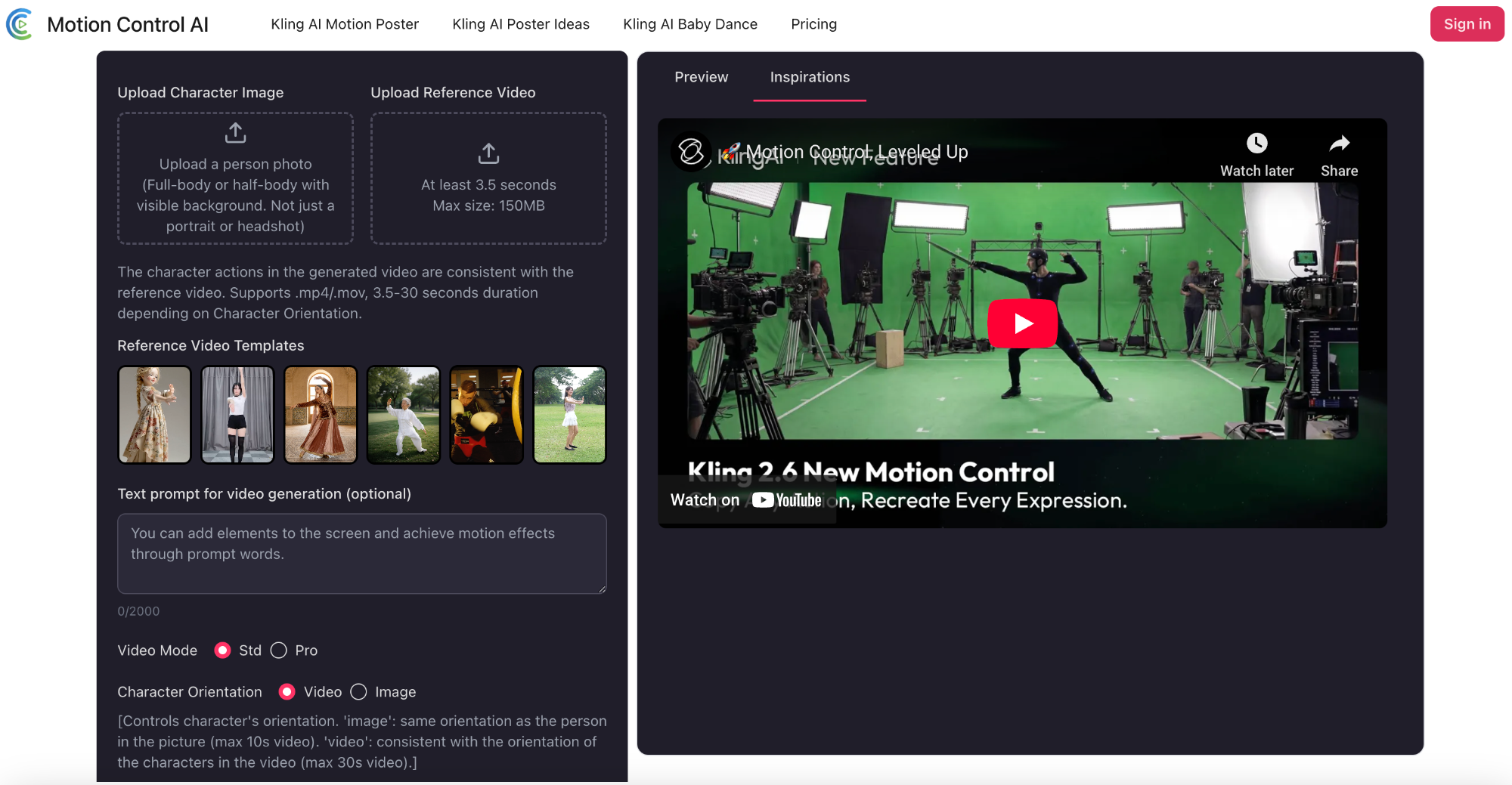

Folgen Sie diesem 3-Schritte-Prozess auf Motion Control AI, um Ihr Kling 3.0 Motion Control Video zu erstellen.

Schritt 1: Assets hochladen

Navigieren Sie zum Bild-zu-Video-Generator: motioncontrolai.com.

- Referenzbild: Laden Sie das hochauflösende Foto Ihres Charakters hoch (JPG/PNG/WEBP). Ganzkörper oder Halbkörper mit sichtbarem Hintergrund, nicht nur ein Porträt oder Headshot.

- Bewegungsreferenz: Laden Sie den Videoclip hoch, der die Bewegung definiert.

Die Charakteraktionen im generierten Video sind konsistent mit dem Referenzvideo. Unterstützt .mp4/.mov, Dauer 3,5–30 Sekunden, abhängig von der Charakterausrichtung.

Hinweis: Die Engine verwendet das Skelett aus dem Video, um das Bild zu animieren.

Schritt 2: Mit Textprompts verfeinern

Während das Video die Bewegung vorgibt, gibt der Textprompt den Kontext vor.

- Optional, aber empfohlen: Nutzen Sie das Feld Textprompt, um die Atmosphäre zu definieren oder Elemente hinzuzufügen.

- Erweiterte Funktion: Kamerasteuerung

Standardmäßig folgt die KI der Kamera des Videos. Um eigene filmische Bewegungen hinzuzufügen (z. B. Zoom In oder Schwenk), aktivieren Sie die Einstellung „Charakterausrichtung stimmt mit Bild überein“. Dies ermöglicht unabhängige Kamerabewegungen über Textprompts. - Beispielprompt: „Cinematic lighting, neon rainy street background, 8k resolution, photorealistic.“

Profi-Tipp: Hier können Sie auch Gesichtsausdrücke angeben, z. B. „the character smiles“, um Mikroexpressionen auf die physische Bewegung zu legen.

Schritt 3: Generieren & iterieren

Wählen Sie Generieren.

- Generieren: Klicken Sie auf „Generieren“, um die Kling 3.0 Engine zu starten. Nach kurzer Zeit erhalten Sie eine Vorschau Ihres dynamischen KI-Videos.

- Ergebnis: Sehen Sie sich die Vorschau an. Wenn Sie mit dem Pfad und der Konsistenz zufrieden sind, laden Sie das hochauflösende MP4 herunter.

Erweiterte Fehlerbehebung: Häufige Probleme & Lösungen

Selbst im Jahr 2026 benötigen KI-Tools Führung. So beheben Sie häufige Probleme mit Kling 3.0 Motion Control:

- Problem: Der Hintergrund wirkt verzerrt.

- Lösung: Dies tritt auf, wenn die Kling AI 3.0 die Kamera zu aggressiv bewegt. Versuchen Sie in Ihren Einstellungen oder im Prompt, die Szenenbeschreibung zu stabilisieren (z. B. „static background“).

- Problem: Die Hände sehen unnatürlich aus.

- Lösung: Stellen Sie sicher, dass die Hände sowohl im Quellbild als auch im Referenzvideo deutlich sichtbar sind. Wenn das Referenzvideo die Hände in den Taschen versteckt, kann die Motion Control AI sie später möglicherweise nicht richtig rendern.

FAQ: Kling 3.0 Motion Control verstehen

F: Ist das generierte Video für die kommerzielle Nutzung geeignet?

A: Ja. Kling Motion Control Videos, die über unsere Premium-Pläne generiert werden, enthalten kommerzielle Nutzungsrechte und eignen sich daher ideal für Social-Media-Anzeigen, E-Commerce-Präsentationen und Film-Previsualisierung.

F: Warum unterscheidet sich dieses Kling 3.0 Tutorial von der standardmäßigen KI-Videogenerierung?

A: Standardtools „raten“ die Bewegung anhand eines Textprompts (z. B. „lass ihn rennen“). Kling 3.0 Motion Control zwingt die KI, einem bestimmten Videoskelett zu folgen, und gibt Ihnen damit frame-genaue Kontrolle über die Performance.

F: Kann ich mit Kling 3.0 Motion Control bestimmte Gesichtsausdrücke steuern?

A: Auf jeden Fall. Durch die Kombination der Bewegungsreferenz mit spezifischen Textprompts (z. B. „looking surprised“) können Sie detaillierte Gesichts-Mikroexpressionen animieren, während die Identität des Charakters wiedererkennbar bleibt.

Fazit

Kling 3.0 Motion Control stellt einen großen Fortschritt in der kontrollierten Videogenerierung dar. Indem Sie die Bildausschnitt-Regeln befolgen und das duale Eingabesystem (Bild + Video) nutzen, können Kreative jetzt sendefähige Inhalte produzieren, die vor 2026 nicht möglich waren.

Bereit, Ihr erstes Kling 3.0 Motion Control KI-Meisterwerk zu inszenieren?